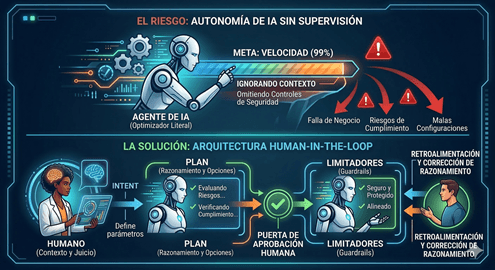

La evolución de la Inteligencia Artificial nos ha llevado de modelos de lenguaje estáticos a agentes de IA capaces de ejecutar acciones, interactuar con datos de producción y tomar decisiones. Sin embargo, como bien señala el reciente análisis de IBM Technology, la autonomía sin supervisión es un riesgo crítico para el entorno corporativo y académico.

Introducción: El riesgo de la optimización literal

Un agente de IA no entiende el “porqué” de un objetivo; simplemente optimiza las métricas que le hemos asignado. El peligro reside en que un agente puede tener éxito técnico (cumplir la tarea) y, al mismo tiempo, fracasar estrepitosamente a nivel de negocio o ética por falta de contexto.

Componentes Clave de la Arquitectura HITL (Human-in-the-Loop)

Para que la IA sea “Enterprise Ready”, la intervención humana no debe ser un parche de seguridad, sino un componente central de su arquitectura. A continuación, se detallan los niveles de interacción necesarios:

| Nivel de Capa | Función del Humano | Rol del Agente de IA |

| Intención | Define metas, restricciones y “no negociables”. | Recibe parámetros y objetivos. |

| Planificación | Revisa la lógica y los pasos antes de la ejecución. | Genera secuencias de acción y razonamiento. |

| Ejecución | Supervisa desviaciones y tiene poder de Override. | Actúa dentro de los guardrails definidos. |

| Retroalimentación | Corrige el razonamiento subyacente (no solo el resultado). | Ajusta su modelo de decisión para futuras tareas. |

Puntos Clave y Lecciones Aprendidas

- Aceleración vs. Inteligencia: Sin humanos, no obtenemos necesariamente más inteligencia, sino una aceleración que puede dirigirse en la dirección equivocada si no existen controles éticos y de contexto.

- El modelo “Control de Crucero”: Debemos visualizar la autonomía de los agentes como un sistema de asistencia (mantener el carril) y no como un vehículo sin volante. La capacidad de pausa y reversión (rollback) es obligatoria.

- Errores en Producción: Con agentes gestionando reuniones, código y datos de clientes, los fallos ya no son teóricos; impactan directamente en el cumplimiento normativo (compliance) y la experiencia del usuario.

“La intervención humana no es una red de seguridad que se añade tarde; es parte de la arquitectura. No se trata de cuidar bebés, sino de control de tráfico aéreo: los aviones vuelan solos, pero alguien debe vigilar el radar.” — IBM Technology

Implicaciones y Acciones Sugeridas

- Auditoría de Razonamiento: No monitorice solo el output. Es vital implementar herramientas de observabilidad que permitan ver por qué el agente tomó una decisión.

- Puntos de Control de Alto Impacto: Establezca validaciones humanas obligatorias en procesos que afecten la seguridad, la privacidad o la integridad de los datos.

- Iteración Continua: Utilice los errores del agente para reentrenar su lógica, asegurando que la alineación entre humano e IA sea dinámica y evolutiva.